Hace más de 150 años, Samuel Butler, escritor y crítico inglés, planteó la posibilidad de que las máquinas evolucionaran y hasta superaran a la humanidad, generando un debate que resuena hasta nuestros días con el auge de la Inteligencia Artificial. Sus ideas, plasmadas en su novela «Erewhon», donde una sociedad destruye las máquinas por temor a ser dominada, se cruzan con las actuales discusiones sobre los riesgos y la necesidad de regular el desarrollo de la IA.

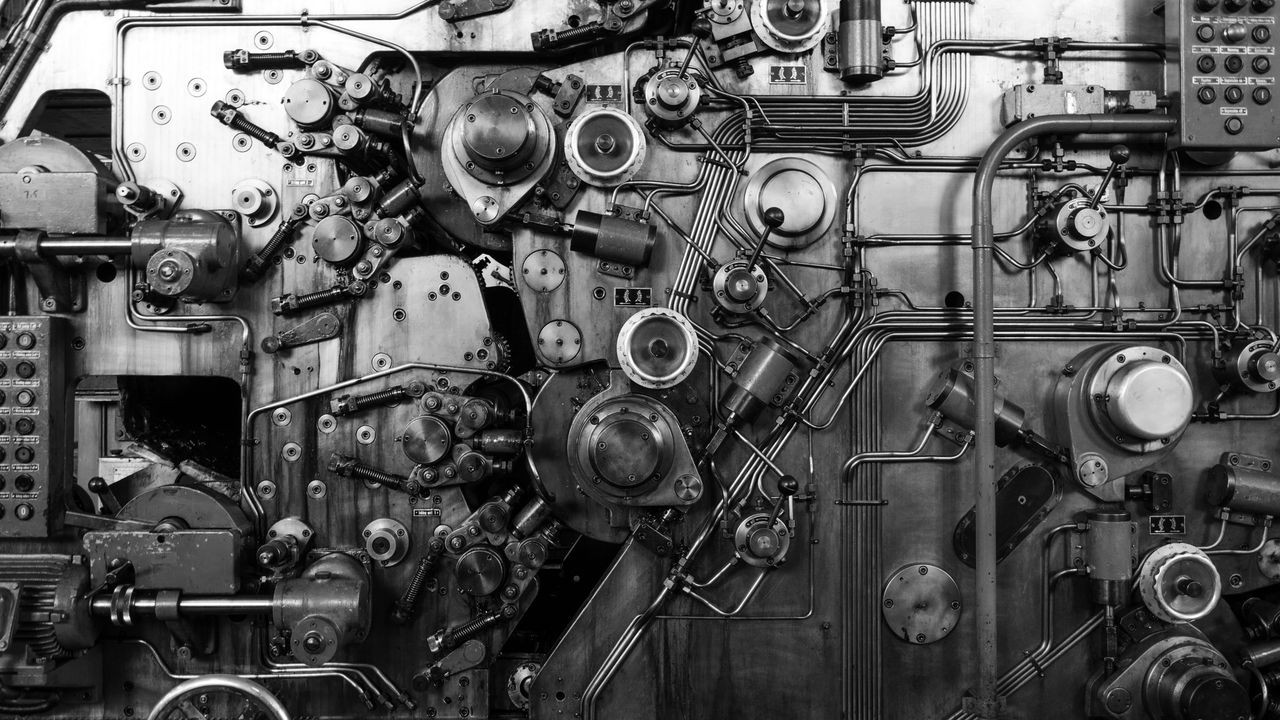

En 1863, mientras la Revolución Industrial echaba humo y los relojes daban la hora con precisión suiza, un tal Samuel Butler se animaba a pensar en voz alta (y por escrito) sobre el futuro de las «máquinas». No hablamos de un visionario salido de Silicon Valley, sino de un tipo que extrapolaba la automatización mecánica a terrenos… digamos, un poco más pantanosos.

La idea central: ¿y si las máquinas, en una de esas, evolucionan hasta el punto de hacernos sombra? Butler, lejos de ser un luddita trasnochado, analizaba la «taxonomía de la evolución de las máquinas», imaginando «géneros y subgéneros» mecánicos. Como esos vertebrados primitivos que se hicieron más pequeños y sofisticados, ¿podrían las máquinas seguir un camino similar?

### ¿Profecía o paranoia tecnológica?

Algunos lo tildaron de hereje, de querer satirizar la teoría de Darwin, pero él se defendió a capa y espada. De hecho, le profesaba un profundo respeto al mismísimo Darwin, al punto de defender «El origen de las especies» en la prensa neozelandesa. Lo que sí es innegable es que, en su novela «Erewhon», pintó un panorama donde las máquinas eran vistas como una amenaza y, por ende, destruidas sin miramientos. ¿Exagerado? Tal vez. ¿Anticipatorio? Mmmm… ahí la cosa se pone interesante.

Lo notable es que Butler se adelantó a su tiempo. En 1863, las computadoras eran poco más que calculadoras gigantes, y la primera «compu» programable tardaría 70 años en ver la luz. Sin embargo, él ya estaba pensando en la «inteligencia artificial» (aunque no la llamara así) y en los posibles riesgos que podría acarrear.

## El debate eterno: ¿nos dominarán las máquinas?

Avancemos rápido hasta 2023. El lanzamiento del GPT-4 de OpenAI desató una ola de pánico. Investigadores hablando de «comportamiento de búsqueda de poder», ecos de la autorreplicación y la toma de decisiones autónoma… casi como una película de ciencia ficción clase B.

Pero la cosa se puso seria. Cartas abiertas firmadas por capos de la industria, advertencias sobre «riesgos de extinción», pedidos de pausa en el desarrollo de la IA… ¡Un cocoliche! Incluso el bueno de Sam Altman (el CEO de OpenAI, para más señas) tuvo que ir al Senado de Estados Unidos a testificar sobre los peligros de su propia creación.

En California, el legislador Scott Wiener propuso un proyecto de ley para regular la IA, respaldado por esos que algunos llaman «agoreros de la IA». Los críticos, por supuesto, saltaron como leche hervida, acusándolos de exagerados y de querer frenar la innovación, como los habitantes de «Erewhon».

### ¿Estamos condenados a repetir la historia?

Más allá de las hipérboles y los miedos infundados, lo cierto es que el debate planteado por Butler hace más de un siglo sigue resonando. ¿Debemos abrazar la tecnología sin reparos, confiando en que todo saldrá bien? ¿O es necesario ponerle un freno, regular su avance y evitar que las máquinas se conviertan en nuestros amos? Nadie tiene la respuesta, pero la pregunta sigue ahí, picando como un mosquito en una noche de verano.