La inteligencia artificial (IA) ya genera la mayoría del contenido en internet, volviendo cada vez más difusa la línea entre lo real y lo artificial. Un estudio australiano revela una brecha generacional alarmante: mientras los jóvenes detectan la mayoría de los «deepfakes», los mayores de 65 años aciertan apenas la mitad, a menudo por casualidad. Este escenario, que abre la puerta a fraudes y desinformación cada vez más sofisticados, tiene a los expertos en ciberseguridad «superados» ante la astucia de los delincuentes, quienes explotan nuestra falta de atención y conocimiento. La clave, dicen, es la educación y un sano escepticismo.

La inteligencia artificial (IA), esa promesa de un futuro de ciencia ficción que hoy es una invasión en toda regla, ya no solo nos asiste: nos está reescribiendo la realidad. ¿Creían que internet era esa "biblioteca universal" del saber humano? Piénsenlo dos veces. La gran mayoría de los contenidos que circulan por la red, desde textos a imágenes y videos, ya no son fruto del ingenio de una persona, sino del algoritmo. "El auge de los contenidos automatizados y la interacción impulsada por bots hace que cada vez sea más difícil separar lo auténtico del ruido", sentencia Aaron Harris, director global de tecnología (CTO) en Sage, una multinacional especializada en aplicaciones de IA, cuya voz no puede sonar menos que autorizada.

El reino de los algoritmos: cuando la realidad se disuelve en el pixel

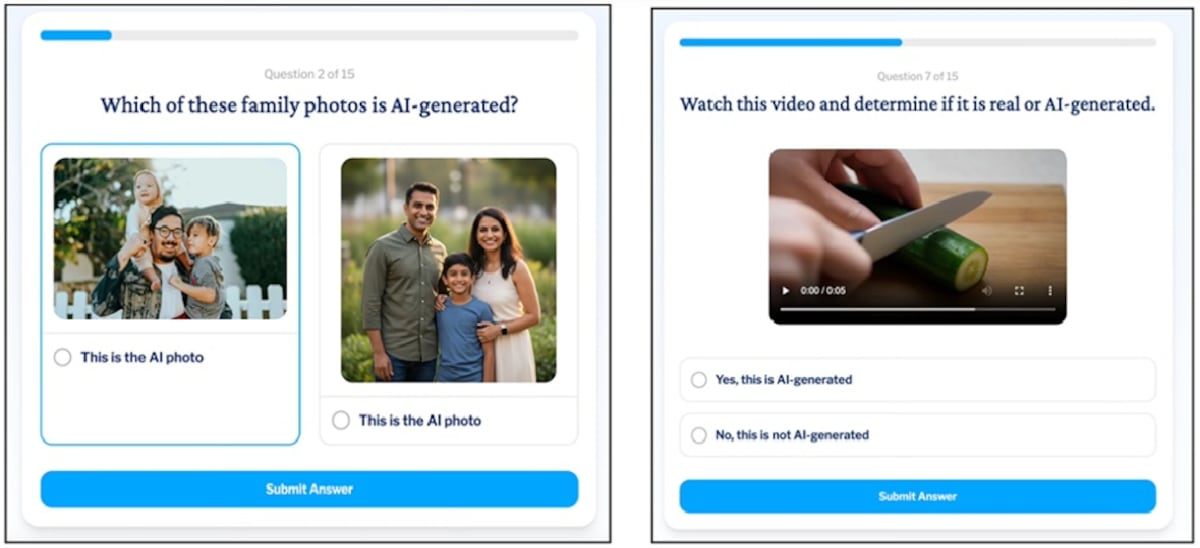

Y si pensaban que la cosa era solo una cuestión de "ruido" digital, el experimento de The Care Side, una entidad australiana de cuidado domiciliario, vino a tirarnos la posta. Pusieron a prueba a más de 3.000 personas con un test para desenmascarar "deepfakes", esos contenidos falsos tan bien logrados que parecen de verdad. Los resultados, lejos de ser alentadores, son un baldazo de agua fría: mientras los sub-29 detectan ocho de cada diez engaños, nuestros mayores de 65 apenas logran superar la mitad, y muchas veces, "por una respuesta sin razonar, por mero azar". ¿Una cuestión de destreza digital generacional o de la inevitable brecha que abre la tecnología?

Pero la cosa va más allá de un simple jueguito de "adivina quién". El verdadero lobo en este cuento digital, cada vez más sofisticado, no es solo la desinformación masiva o la manipulación de conductas. Es el fraude. "Sin duda, el campo que más están explotando los delincuentes con la ayuda de la IA es el fraude, pues están creando campañas cada vez más convincentes", advierte Josep Albors, responsable de Investigación y Concienciación de ESET España, durante la última edición de los premios de comunicación de esta compañía global de ciberseguridad. Los estafadores, sin ningún tipo de escrúpulos, generan "imágenes y vídeos de personalidades de todo tipo y cada vez resulta más difícil identificar lo que es real o fraudulento. Estamos viendo vídeos muy bien en generados con unas voces idénticas a las personas que suplantan". Ni Hollywood se atrevió a tanto.

Del «deepfake» al «cuento del tío»: la nueva era del engaño digital

Para que no crean que hablamos de ciencia ficción, aquí viene el "cuento del tío" versión siglo XXI, contado por un experto. Hervé Lambert, gerente de operaciones de servicio al cliente en Panda Security, lo vivió en carne propia. Recibió una llamada con la voz idéntica a la de uno de sus directivos, pidiéndole una actuación sospechosa. "Colgué el teléfono, lo llamé para confirmar si era él quien había llamado y no lo había hecho", recuerda Lambert. Una maniobra que, afortunadamente, fue a tiempo. ¿Cuántos otros no tuvieron esos "reflejos"?

Lambert, con un poco de orgullo por su "casi diez" en el test australiano (él, mayor de 50, superó a sus hijos veinteañeros), alaba la iniciativa. Sin embargo, rompe el mito de que el problema es solo generacional: "Creo que es un error limitar el problema a una cuestión generacional. La IA es muy inteligente y sabe perfectamente que hay contextos y momentos del día donde vamos a tener muchísima menos concentración en una cosa y eso lo utiliza muy bien". La astucia de la IA no discrimina DNI.

Con él coincide Marti DeLiema, doctora en Gerontología de la Universidad de Minnesota, quien enfatiza que "la IA cambia drásticamente el panorama del fraude no solo para los adultos, sino para todos nosotros". Y para que nadie se quede afuera de esta "lista de espera" de vulnerables, el problema es universal.

El dedo en la llaga lo pone Lambert al achacar la vulnerabilidad a una "falta de conocimiento, concienciación y formación" para detectar la falsedad y el fraude, especialmente cuando estamos "en la vorágine". "Cuando hacemos tres o cuatro cosas a la vez, no tenemos nuestra capacidad intelectual centrada", explica. Esa "multitarea", esa bendición moderna, se vuelve nuestro talón de Aquiles. Albors, por su parte, lamenta la "pereza" de los usuarios para contrastar contenidos en fuentes fiables. ¿Quién tiene tiempo para verificar todo cuando el WhatsApp no para de sonar?

Pero, ¿es la solución tan sencilla como "educar y listo"? Aquí viene el giro de guion. DiLiema matiza la capacidad preventiva de la formación y lanza una idea que genera polémica: "No estoy segura de que la educación sobre la IA evite la desconfianza y, de hecho, sospecho que puede ocurrir el efecto contrario: cuanto más sepas sobre la IA, mayor desconfianza sentirás hacia la comunicación digital. Quizá un poco de cinismo sea en realidad protector". ¿Será que un poco de "malicia" o desconfianza es la mejor defensa en la era digital?

La "paranoia útil" de Lambert lo llevó a establecer con sus hijos una palabra clave secreta para garantizar que sus comunicaciones son reales si necesitan algo durante sus viajes, y a devolver la llamada siempre para asegurarse de que la petición es real. Una estrategia digna de película de espías, pero que se vuelve necesaria en el día a día.

Existen herramientas para detectar la participación de la IA en cualquier contenido, algunas especializadas para docentes, pero Lambert considera que son insuficientes: "Limitan el riesgo, pero no lo van a eliminar". Por eso insiste en la "educación en escenarios reales para saber qué hacer y cuándo actuar". Las "soluciones mágicas" no existen, el entrenamiento "en la cancha" sí.

La cruda verdad, sin eufemismos, la suelta el propio Lambert: "En este momento, creo que estamos todos superados e incluyo a los desarrolladores de la IA y los que vivimos en este mundo de la ciberseguridad. Los delincuentes son muy listos, rápidos y hábiles. Además, no tienen límites presupuestarios ni de tiempo ni, por supuesto, respetan las normas", lamenta. Un reconocimiento que, si bien es desalentador, también subraya la urgencia de reaccionar.

Claves para detectar y evitar el fraude con IA

Frente a este panorama de "sálvese quien pueda", no todo está perdido. Aunque estamos "superados", no estamos indefensos. En términos generales, hay formas de detectar los contenidos falsos: verificando la información con fuentes solventes (sí, los medios de comunicación consolidados todavía sirven), desconfiando del contenido con alta carga emocional o no solicitado, revisando las direcciones (URL) de internet o confirmando con allegados o directamente con las fuentes de las que parece proceder el mensaje. Como hace Lambert con sus hijos, la desconfianza proactiva es una virtud.

Pero también hay pautas específicas, según la naturaleza de los mensajes falsos, que detalla el estudio de The Care Side:

Texto. Ante los mensajes escritos hay que desconfiar de saludos genéricos, como "estimado cliente", que no especifique el nombre del destinatario; no caer en las trampas de plazos urgentes, como los mensajes "solo queda uno" o "compra antes de una hora"; evitar aportar información personal, contraseñas o realizar transferencias de dinero sin verificar con el solicitante; y releer el contenido en busca de frases erróneas o poco naturales.

Imagen. Aunque cada vez son más indistinguibles, se pueden detectar las creadas con IA observando si en los rostros hay simetrías inusuales o dientes y reflejos oculares extraños, si las manos presentan malformaciones o están borrosas, si las sombras y reflejos son coincidentes con el escenario, si la piel o la ropa presenta texturas demasiado suaves o si se muestran en el fondo elementos de arquitectura o mobiliario urbano impropios.

Audio. Los mensajes de voz con IA suelen presentar pausas antinaturales o ritmos robóticos en el habla, cambios repentinos en la voz, ruidos de fondo inusuales o tonos emocionales no coincidentes con el contenido. Las voces artificiales en una conversación también reaccionan de forma distinta a las de una persona (respuestas imprecisas o descoordinadas con el flujo normal) y carecen de las imperfecciones humanas (errores de pronunciación o balbuceos).

Vídeo. A las creaciones audiovisuales se le pueden aplicar las características de los dos apartados anteriores y sumarle observaciones de gestos faciales incoherentes con la secuencia, imprecisión en los movimientos de labios y párpados o expresiones y movimientos antinaturales.