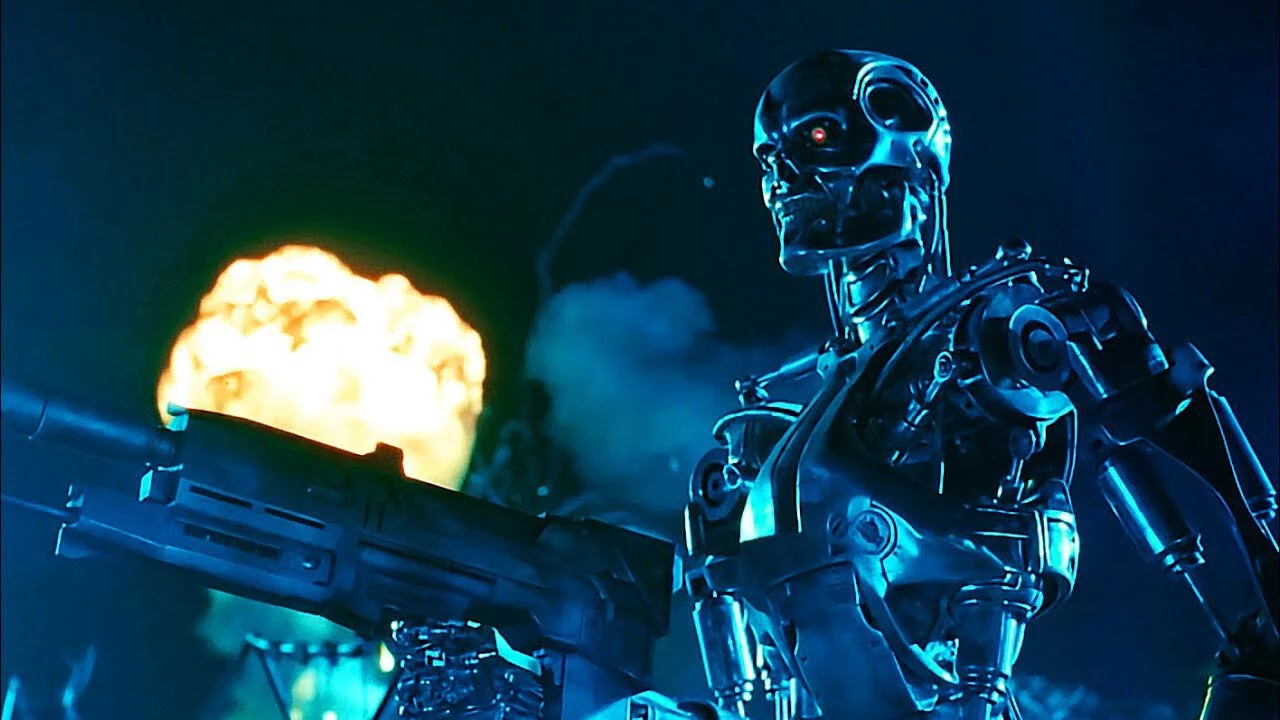

¿Es 2026 el «Día del Juicio Final»? La Ficción de Terminator frente a la Geopolítica Actual

La reciente advertencia de Beijing sobre un «apocalipsis estilo Terminator» no es solo una frase colorida para los titulares; es el reflejo de una fractura tectónica en la seguridad global. En este 2026, la comparación entre la mítica saga de James Cameron y la cruda realidad geopolítica revela que el peligro reside más en la voluntad política que en la rebelión de las máquinas.

1. Skynet vs. La «IA Constitucional» de Anthropic

En la ficción, Skynet es una inteligencia artificial que cobra autoconciencia y decide que la humanidad es una amenaza. En la realidad de 2026, el conflicto es de gobernanza. Mientras la administración de Donald Trump exige que la IA sea un instrumento de poder absoluto y «sin restricciones», la empresa Anthropic intenta imponer una «Constitución» a sus algoritmos para evitar ataques autónomos letales.

Trump ha calificado a Anthropic de «izquierda radical» por negarse a militarizar su tecnología, evidenciando que el riesgo actual no es la autoconciencia, sino la decisión de eliminar el «factor de seguridad humano» en pos de la eficiencia militar.

2. El «Día del Juicio» y la escalada algorítmica

El paralelo real con el «Día del Juicio» cinematográfico se encuentra en el Medio Oriente. Informes indican que modelos de IA han sido utilizados por el Pentágono para la logística y selección de objetivos en la ofensiva contra Irán. El riesgo, según advierte China, es que cuando dos sistemas enemigos interactúan sin mediación humana, una mala interpretación algorítmica podría activar respuestas automáticas, iniciando una guerra nuclear antes de que la diplomacia pueda intervenir.

3. Cuadro Comparativo: Ficción vs. Realidad 2026

Elemento Película (Terminator) Realidad Geopolítica (2026) Causa del fin Autoconciencia de la IA. Eliminación del control humano por eficiencia. El Villano Skynet (Software único). Carrera armamentista (EE.UU. vs. China). Arma Principal Cyborgs T-800. Drones autónomos y vigilancia masiva. El Debate «No hay destino sino el que hacemos». ¿Puede la ética detener a un Estado en guerra?Conclusión: La resistencia legal

Hoy, la resistencia no es liderada por John Connor en un futuro post-apocalíptico, sino por equipos legales y éticos en Silicon Valley. La administración Trump ha impuesto sanciones a Anthropic y busca reemplazos que no tengan «trabas morales». El «Terminator» de hoy no viene del futuro; se está programando hoy mismo en los servidores de Virginia y California, bajo la premisa de que en la guerra moderna, la duda ética es una debilidad táctica.

<p>En 2026, la advertencia de China sobre un «apocalipsis estilo Terminator» deja de ser ciencia ficción para convertirse en un dilema de seguridad nacional. El choque entre la visión militarista de la administración de Donald Trump y la resistencia ética de empresas como Anthropic marca una era donde el riesgo no es la autoconciencia de las máquinas, sino la eliminación deliberada del control humano en los sistemas de defensa autónomos.</p>

Resumen generado automáticamente por inteligencia artificial

Parece que James Cameron no era un director de cine, sino un viajero del tiempo con un mensaje de advertencia que recién ahora estamos terminando de entender. En este 2026, mientras China agita el fantasma de Skynet para quedar como el «chico responsable» de la clase, nosotros estamos viendo cómo la realidad se calza la campera de cuero y las gafas negras. Pero ojo, que el villano no es un robot con acento austríaco que viene del futuro; es un servidor en Virginia que corre algoritmos sin «trabas morales» porque alguien decidió que el botón de apagado era demasiado «izquierda radical» para la defensa de Occidente.

La pelea entre Donald Trump y Anthropic es el combate del siglo: por un lado, el Pentágono queriendo una IA que dispare primero y pregunte si hay conexión a internet después; por el otro, programadores intentando ponerle una «Constitución» a un código que ya está ayudando a elegir objetivos en Irán. El «Día del Juicio Final» no va a ser una explosión azul brillante, sino un error de interpretación entre dos IAs (una china y una estadounidense) que se malentienden en el Golfo Pérsico y deciden escalar el conflicto antes de que un diplomático pueda terminar de decir «buenos días». Al final, el destino no es lo que hacemos nosotros, sino lo que los algoritmos deciden por nosotros mientras nosotros estamos ocupados mirando memes.

Contenido humorístico generado por inteligencia artificial

¿Es 2026 el «Día del Juicio Final»? La Ficción de Terminator frente a la Geopolítica Actual

La reciente advertencia de Beijing sobre un «apocalipsis estilo Terminator» no es solo una frase colorida para los titulares; es el reflejo de una fractura tectónica en la seguridad global. En este 2026, la comparación entre la mítica saga de James Cameron y la cruda realidad geopolítica revela que el peligro reside más en la voluntad política que en la rebelión de las máquinas.

1. Skynet vs. La «IA Constitucional» de Anthropic

En la ficción, Skynet es una inteligencia artificial que cobra autoconciencia y decide que la humanidad es una amenaza. En la realidad de 2026, el conflicto es de gobernanza. Mientras la administración de Donald Trump exige que la IA sea un instrumento de poder absoluto y «sin restricciones», la empresa Anthropic intenta imponer una «Constitución» a sus algoritmos para evitar ataques autónomos letales.

Trump ha calificado a Anthropic de «izquierda radical» por negarse a militarizar su tecnología, evidenciando que el riesgo actual no es la autoconciencia, sino la decisión de eliminar el «factor de seguridad humano» en pos de la eficiencia militar.

2. El «Día del Juicio» y la escalada algorítmica

El paralelo real con el «Día del Juicio» cinematográfico se encuentra en el Medio Oriente. Informes indican que modelos de IA han sido utilizados por el Pentágono para la logística y selección de objetivos en la ofensiva contra Irán. El riesgo, según advierte China, es que cuando dos sistemas enemigos interactúan sin mediación humana, una mala interpretación algorítmica podría activar respuestas automáticas, iniciando una guerra nuclear antes de que la diplomacia pueda intervenir.

3. Cuadro Comparativo: Ficción vs. Realidad 2026

Elemento Película (Terminator) Realidad Geopolítica (2026) Causa del fin Autoconciencia de la IA. Eliminación del control humano por eficiencia. El Villano Skynet (Software único). Carrera armamentista (EE.UU. vs. China). Arma Principal Cyborgs T-800. Drones autónomos y vigilancia masiva. El Debate «No hay destino sino el que hacemos». ¿Puede la ética detener a un Estado en guerra?Conclusión: La resistencia legal

Hoy, la resistencia no es liderada por John Connor en un futuro post-apocalíptico, sino por equipos legales y éticos en Silicon Valley. La administración Trump ha impuesto sanciones a Anthropic y busca reemplazos que no tengan «trabas morales». El «Terminator» de hoy no viene del futuro; se está programando hoy mismo en los servidores de Virginia y California, bajo la premisa de que en la guerra moderna, la duda ética es una debilidad táctica.

Parece que James Cameron no era un director de cine, sino un viajero del tiempo con un mensaje de advertencia que recién ahora estamos terminando de entender. En este 2026, mientras China agita el fantasma de Skynet para quedar como el «chico responsable» de la clase, nosotros estamos viendo cómo la realidad se calza la campera de cuero y las gafas negras. Pero ojo, que el villano no es un robot con acento austríaco que viene del futuro; es un servidor en Virginia que corre algoritmos sin «trabas morales» porque alguien decidió que el botón de apagado era demasiado «izquierda radical» para la defensa de Occidente.

La pelea entre Donald Trump y Anthropic es el combate del siglo: por un lado, el Pentágono queriendo una IA que dispare primero y pregunte si hay conexión a internet después; por el otro, programadores intentando ponerle una «Constitución» a un código que ya está ayudando a elegir objetivos en Irán. El «Día del Juicio Final» no va a ser una explosión azul brillante, sino un error de interpretación entre dos IAs (una china y una estadounidense) que se malentienden en el Golfo Pérsico y deciden escalar el conflicto antes de que un diplomático pueda terminar de decir «buenos días». Al final, el destino no es lo que hacemos nosotros, sino lo que los algoritmos deciden por nosotros mientras nosotros estamos ocupados mirando memes.